Multimedia

Esta categoría es para clasificar contenidos en la Zona secundaria de la página principal.

Borges, Chomsky, computadoras y el Maestro Yoda

Activaciones Mutantes

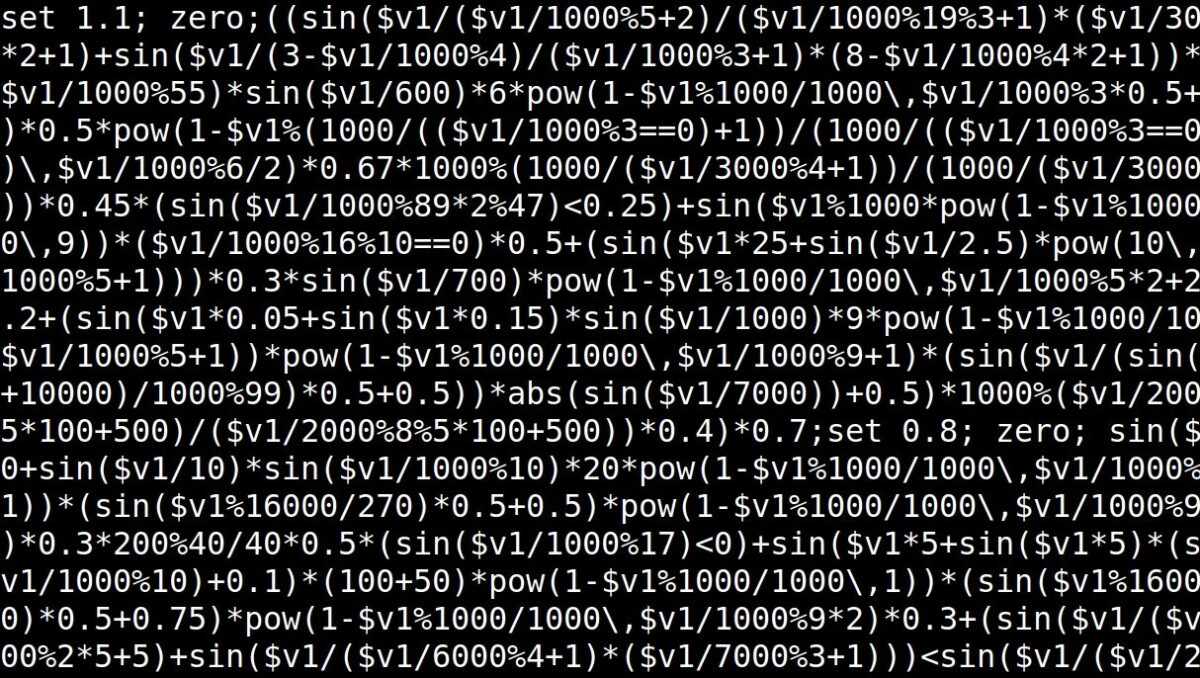

Del siglo de oro de Pericles a la síntesis digital de bajos recursos

Nuevas líneas de acción comunitarias: capacitación

Acción Sonora por la Identidad (ASI)

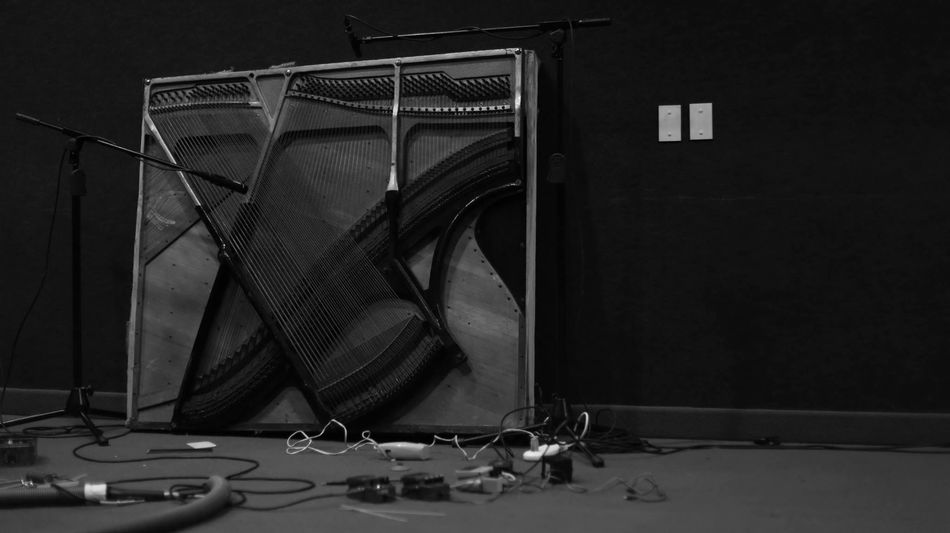

Cruces

Sonidos mutantes